瞄準AI下一站!360開源視覺語言對齊模型FG-CLIP2,撬動具身智能與商業(yè)增長

分享到微信

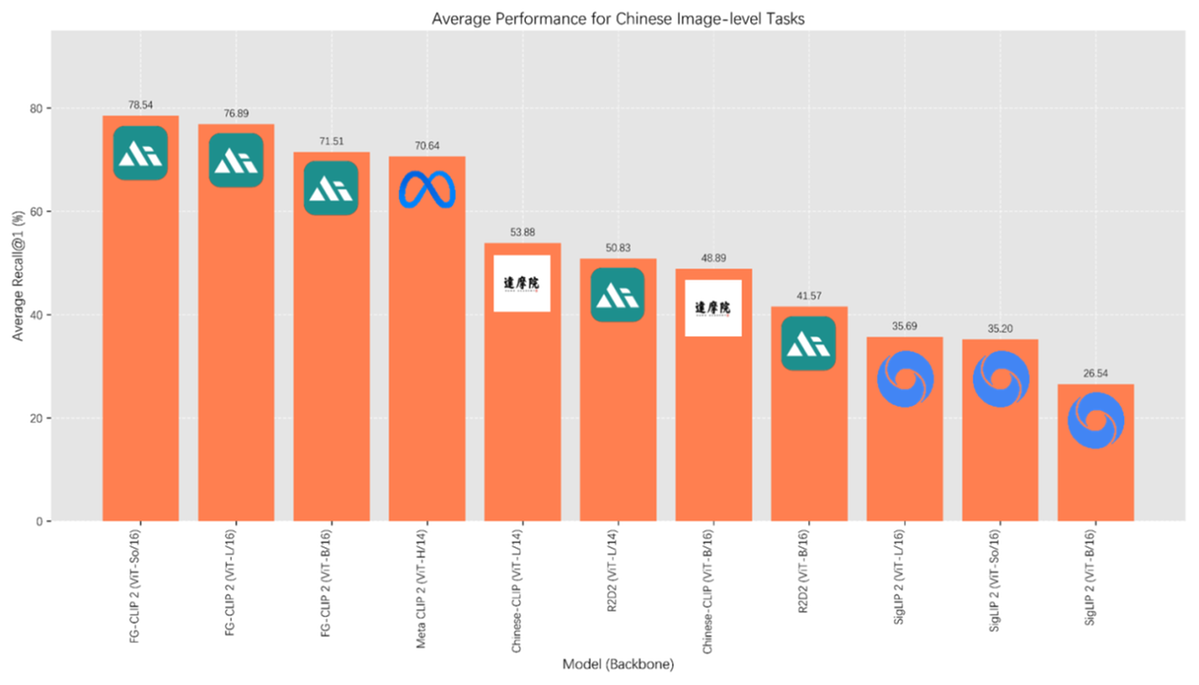

【環(huán)球網(wǎng)科技綜合報道】當行業(yè)還在卷大模型參數(shù)時,360已悄然在AI的“視力”上實現(xiàn)了降維打擊。其最新開源的FG-CLIP2模型,憑借對圖像細節(jié)的極致理解,在多項測試中超越谷歌、Meta同類產(chǎn)品,成為全球最強的視覺語言模型。

FG-CLIP2的核心突破在于解決了“細粒度識別”問題。這對于正處風口的具身智能和商業(yè)智能化至關重要。想象一下,家庭機器人能根據(jù)“拿起茶幾上屏幕有裂痕的手機”這樣的指令準確行動;安防系統(tǒng)能通過“尋找戴黑色鴨舌帽的可疑人員”瞬間鎖定目標。FG-CLIP2讓機器對世界的理解從“大概”變?yōu)椤熬_”,為真正的實用化AI奠定了基礎。

作為國內(nèi)較早布局人工智能的企業(yè),360依托搜索、瀏覽器等核心業(yè)務積累的百億級圖文數(shù)據(jù),以及自研的大規(guī)模高質量數(shù)據(jù)集FineHARD,深耕AI底層能力,持續(xù)推進中國構建自主可控的AI技術體系。(古雨)

【責任編輯:馬芮】

- 瞄準AI下一站!360開源視覺語言對齊模型FG-CLIP2,撬動具身智能與商業(yè)增長

- 2025年度交通運輸行業(yè)高質量發(fā)展大會在南京舉行

- 非洲10國媒體人熱議中非減貧合作

- UPET有寵生活展北京盛大開幕,開啟人寵品質生活新時代

- 中外青年齊聚副中心——這場綠色對話,讓中國故事 “聲” 動全球

- 周鴻祎力作《數(shù)字安全網(wǎng)絡戰(zhàn)》獲得國家級學會推介,AI 時代更需“精準看見”

- 納米AI創(chuàng)作者赴疆支教 讓AI火種扎根邊疆點亮學生科技夢

- 青春華章|漫評:江河安瀾間,盡是青春筑夢的足跡

- 匈牙利總理重申不支持烏克蘭加入歐盟

- "十四五"期間我國茶油產(chǎn)量增長53%

- 中國足協(xié)聘任邵佳一為國足主教練

- 今年西部陸海新通道班列累運量突破120萬標箱

- 進博會新聞中心再升級 新服務獲中外記者好評

- 香港旅發(fā)局以光影激活傳統(tǒng),點亮 “亞洲國際都會” 進博時刻

- 每日一詞 | 熱點論文 hot papers

換一批

- 違法和不良信息舉報

- 互聯(lián)網(wǎng)新聞信息服務許可證10120170006

- 信息網(wǎng)絡傳播視聽節(jié)目許可證0108263號

- 京公網(wǎng)安備11010502032503號

- 京網(wǎng)文[2011]0283-097號

- 京ICP備13028878號-6

中國日報網(wǎng)版權說明:凡注明來源為“中國日報網(wǎng):XXX(署名)”,除與中國日報網(wǎng)簽署內(nèi)容授權協(xié)議的網(wǎng)站外,其他任何網(wǎng)站或單位未經(jīng)允許禁止轉載、使用,違者必究。如需使用,請與010-84883777聯(lián)系;凡本網(wǎng)注明“來源:XXX(非中國日報網(wǎng))”的作品,均轉載自其它媒體,目的在于傳播更多信息,其他媒體如需轉載,請與稿件來源方聯(lián)系,如產(chǎn)生任何問題與本網(wǎng)無關。

版權保護:本網(wǎng)登載的內(nèi)容(包括文字、圖片、多媒體資訊等)版權屬中國日報網(wǎng)(中報國際文化傳媒(北京)有限公司)獨家所有使用。 未經(jīng)中國日報網(wǎng)事先協(xié)議授權,禁止轉載使用。給中國日報網(wǎng)提意見:rx@chinadaily.com.cn